AI 할루시네이션 줄이는 법, 현장에서 검증한 5가지 전략

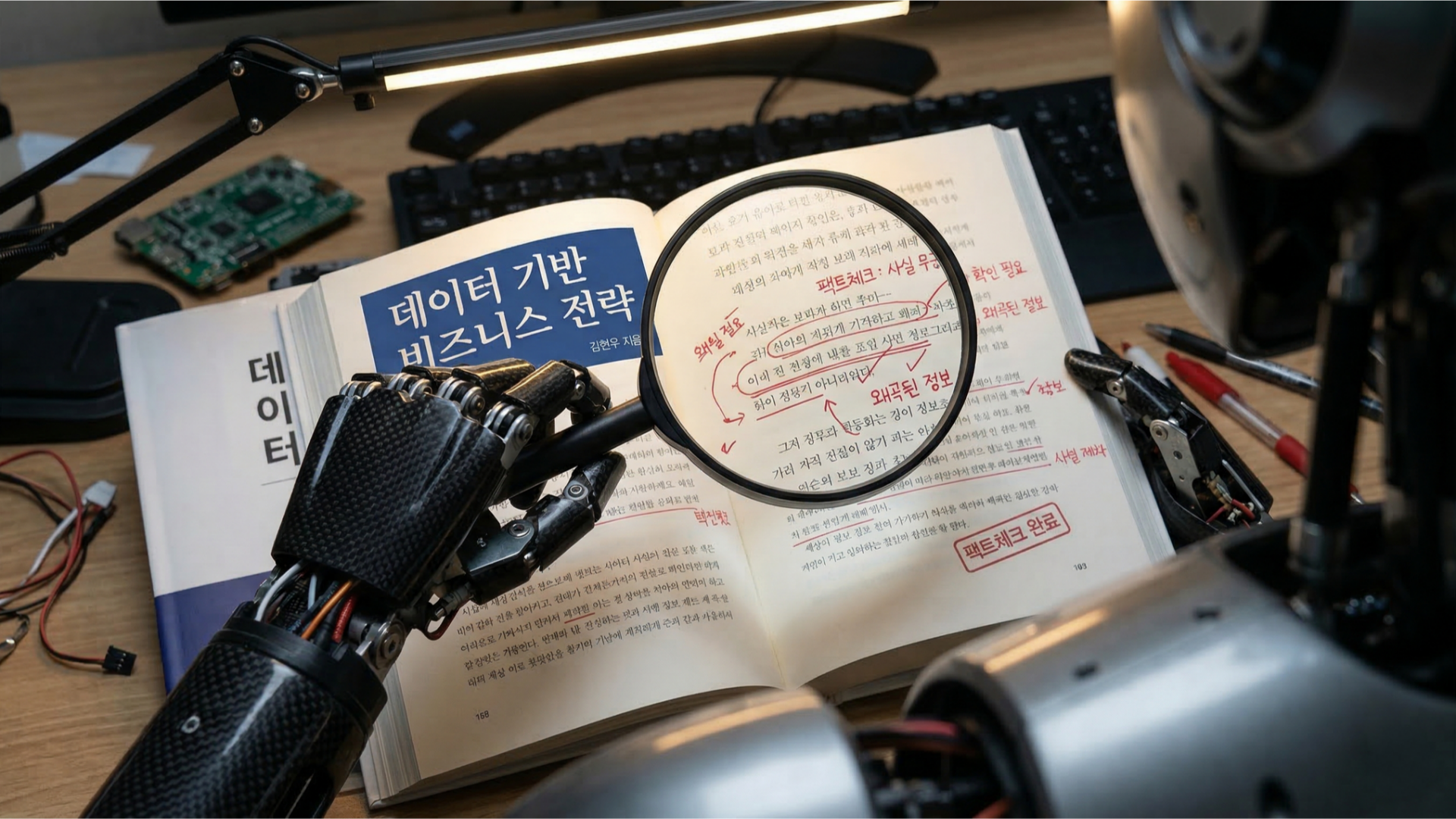

생성형 AI를 업무에 쓰기 시작한 조직에서 빠지지 않는 질문이 있습니다. “너무 그럴싸해서 틀린 답을 못 알아 체면 어떡하죠?” 할루시네이션은 AI가 사실이 아닌 정보를 그럴듯하게 생성하는 현상입니다. 주로 생성형 AI 모델에서 발생하며, 환각처럼 실제와 다른 내용을 출력합니다. 역사적 사실을 왜곡하거나 없는 논문을 인용하기도 하고 가짜 출처를 그럴싸하게 붙이기도 하죠. 완전히 없애기는 어렵지만 발생 빈도를 크게 낮출 수 있어요. 출처 지정, 교차 검증, 추론 모델, 자가검증 프롬프트, RAG—교육 현장에서 직접 효과를 확인한 다섯 가지 대응법을 정리했습니다.

목차

- AI 할루시네이션, 왜 그럴듯한 틀린 답변을 할까

- 출처 지정과 교차 검증으로 기본기 다지기

- 추론 모델과 자가검증 프롬프트 활용법

- RAG로 오답 가능성 자체를 차단하기

- 마무리

AI 할루시네이션, 왜 그럴듯하게 말하는데 틀리는 걸까?

AI가 오답을 내놓는 건 모르면서도 말하기 때문입니다. 대규모 언어 모델은 정답을 검색해서 주는게 아니에요. 확률적으로 자연스러운 다음 단어를 조합하는 원리이기 때문에, 표현은 굉장히 그럴듯하고 매끄럽게 보이지만 내용이 사실과 어긋나는 경우가 생기죠.

기업 교육 시 “AI 결과를 어디까지 신뢰해야 할지 모르겠다”는 이야기가 자주 하십니다. 도구 자체의 문제가 아니에요. 오류가 발생하는 메커니즘을 이해하고 걸러내는 체계를 갖추면, 실무에서 충분히 쓸 만한 결과를 확보할 수 있습니다. 관건은 의심하는 능력이에요.

출처 지정과 교차 검증으로 기본기 다지기

할루시네이션 대응의 출발점은 세 가지 기본 원칙입니다. 널리 알려진 내용이지만, 현장에서 꾸준히 효과를 보이는 방법이에요.

첫째, AI에게 근거 출처를 함께 달라고 요구합니다. “출처와 URL을 반드시 포함해”라고 프롬프트에 넣으면 아는 척하고 넘어가는 빈도가 줄어들어요. 둘째, 출처 범위를 지정합니다. “월스트리트저널 기사 내용만 참고해”처럼 특정 매체나 자료를 한정하면, 여러 소스를 섞어 꾸며낼 여지가 좁아지죠. 셋째, AI 도구끼리 교차 확인을 시킵니다. ChatGPT 답변을 Gemini 딥리서치로 검토하고, 그 결과를 Perplexity에 다시 넣어보는 식이에요.

하나의 AI에만 의존하면 그 모델의 편향을 그대로 받아들이게 됩니다. 학습 데이터가 다른 모델 두세 개를 거치면 사실 관계 오류가 걸러질 확률이 높아져요. 여기까지가 기본기입니다.

추론 모델과 자가검증 프롬프트 활용법

같은 질문이라도 어떤 모델에, 어떤 방식으로 던지느냐에 따라 AI 할루시네이션 발생률이 달라집니다. 모델 선택과 프롬프트 설계를 함께 조정해야 정확도가 올라가요.

추론 모델과 단계별 사고(Chain-of-Thought)

ChatGPT나 Claude의 추론(Thinking) 특화 모델은 응답 전에 내부적으로 여러 단계의 사고 과정을 밟습니다. 한 번에 답을 내놓는 것보다 논리적 비약이 적은 설계예요. 여기에 단계별로 생각해 보자(Let’s think step by step)라는 지시를 더하면, 중간 과정을 건너뛰지 않아 오류 가능성이 한층 내려갑니다. 수치 분석이나 법률 검토처럼 정밀도가 생명인 업무라면, 모델 선택부터 재점검해 볼 필요가 있어요.

CoV(검증의 사슬)로 AI가 스스로 답을 의심하게 만들기

Chain-of-Verification은 네 단계로 구성된 자가검증 절차입니다.

- 1단계: 일반 질문으로 초기 답변 확보

- 2단계: 답변에서 검증이 필요한 지점을 추려 확인 질문 생성

- 3단계: 각 확인 질문에 근거를 들어 재응답

- 4단계: 검증 결과를 반영해 최종 답변 수정

다음 질문에 답해줘: {질문예시 : 2024년 국내 생성형 AI 시장 규모와 주요 성장 동인을 설명해줘.}

답변 후:

1) 스스로 검증 질문 3개 생성

2) 생성한 질문에 답하며 검증

3) 오류 수정 후 최종 답만 출력

제안서나 고객 납품 보고서처럼 정확도가 신뢰와 직결되는 문서에서는 반드시 거칠 만한 과정입니다. 1단계와 4단계 결과를 나란히 놓으면 차이가 분명해요.

적대적 동료 검토 프롬프트

AI에게 까다로운 전문가 역할을 부여한 뒤, 자기 답변을 직접 해체하게 만드는 방식입니다.

당신은 이 분야에서 20년간 실무를 해 온 전문가이자 가장 엄격한 검토자임. 다음 텍스트를 읽고 사실 오류, 출처 없는 주장, 논리적 비약, 허위 인용을 모두 찾아 지적해줘. 각 오류에 대해 왜 문제인지 근거를 함께 제시해라.

이 프롬프트를 적용하면 AI가 “이 부분은 근거가 불충분합니다”처럼 자기 글을 뜯어보기 시작해요. 역할 하나를 바꿨을 뿐인데 응답 태도가 전환되는 거죠. 다만 같은 AI가 학습 과정에서 받아들인 잘못된 정보는 이 방식으로 걸러지지 않을 수 있습니다. 논리적 허점은 적대적 검토로, 사실 관계는 Gemini 딥리서치 같은 외부 검색 도구로 이중 확인하는 순서가 가장 효과적이에요.

RAG로 오답 가능성 자체를 차단하기

앞의 네 가지가 답변을 받은 뒤 검증하는 방향이라면, RAG(Retrieval-Augmented Generation)는 AI가 애초에 지어낼 수 없는 환경을 만드는 전략입니다. RAG는 자체 학습 데이터 대신, 사용자가 올린 문서를 먼저 검색한 뒤 그 범위 안에서만 답변을 생성하는 구조예요.

구글 NotebookLM이 이 원리를 별도 개발 없이 바로 체험할 수 있는 대표적 도구입니다. 문서를 업로드하면 AI가 해당 내용 안에서만 응답하고, 범위 밖 질문에는 “해당 정보를 찾을 수 없습니다”로 돌아오죠. ChatGPT의 GPTs 기능에서 “첨부 자료 안에서만 답변해줘. 절대 없는 내용을 생성하거나 만들어내지마”라고 지시해도 동일한 로직이 작동해요.

AI기업교육 현장에서 이 과정을 시연하면 구글 NotebookLM에 “내부 매뉴얼을 올리면 유용하게 쓸 수 있겠다”라는 피드백이 가장 많이 나와요. 답변 범위를 좁혀주면 지어낼 여지 자체가 사라집니다.

AI 할루시네이션은 피할 수 없지만, 관리할 수 있는 영역입니다. 논리적 허점은 CoV와 적대적 검토로, 사실 관계는 교차 검증과 딥리서치로, 범위 이탈은 RAG로 대응하면 됩니다. 상황에 맞게 골라 조합하는 것 자체가 AI 활용 역량이죠. 도구를 잘 다루는 것도 실력이고, 한계를 파악하는 것도 실력입니다.

한국AI교육진흥원은 할루시네이션 대응을 포함한 실무 중심 AI 교육을 운영하고 있습니다. 이론에 그치지 않고 조직의 실제 업무에 바로 적용할 수 있는 커리큘럼 설계가 저희 강점입니다. AI 교육 도입을 검토 중이시라면 편하게 문의해 주세요.